Uricha Lawsona | Obrazy Getty’ego

W przypadku większości programów komputerowych, nawet tych złożonych, można prześledzić kod i precyzyjnie wykorzystać pamięć, aby go rozgryźć Dlaczego Ten program tworzy określone zachowanie lub wynik. Nie jest to ogólnie prawdą w przypadku generatywnej sztucznej inteligencji, gdzie niewytłumaczalne sieci neuronowe leżące u podstaw tych modeli utrudniają nawet ekspertom dokładne określenie, na przykład, dlaczego często łączą informacje.

Teraz, Nowe badania Anthropic Oferuje nowe okno na to, co dzieje się w „czarnej skrzynce” Claude LLM. Firma Nowy papier W książce „Wydobywanie interpretowalnych cech z 3 sonetu Claude’a” opisuje nowy, potężny sposób przynajmniej częściowego wyjaśnienia, w jaki sposób miliony sztucznych neuronów w modelu uruchamiają się, tworząc zaskakująco realistyczne odpowiedzi na ogólne zapytania.

Otwórz maskę

Analizując LLM, łatwo jest zobaczyć, które konkretne sztuczne neurony są aktywowane w odpowiedzi na dane zapytanie. Ale studia MBA nie przechowują po prostu różnych słów i koncepcji w pojedynczym neuronie. Zamiast tego, jak wyjaśniają badacze Anthropic, „okazuje się, że każde pojęcie jest reprezentowane przez wiele neuronów, a każdy neuron bierze udział w reprezentacji wielu pojęć”.

Posortować ten chaos od jednego do wielu i od wielu do jednego, uporządkować Rzadkie autoenkodery Do działania można wykorzystać złożoną matematykę Algorytm uczenia się słownika. poprzez formularz. Proces ten wskazuje, które grupy neuronów aktywują się bardziej konsekwentnie w przypadku określonych słów pojawiających się w różnych podpowiedziach tekstowych.

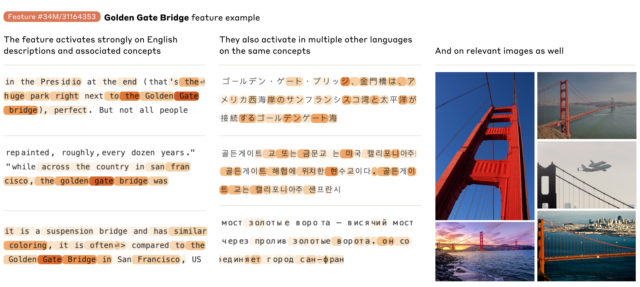

Te wielowymiarowe wzorce neuronowe są następnie sortowane według tak zwanych „cech” związanych z konkretnymi słowami lub pojęciami. Funkcje te mogą obejmować wszystko, od prostych rzeczowników własnych, takich jak mostu Golden Gate Do bardziej abstrakcyjnych pojęć, takich jak Błędy programistyczne Lub Funkcja dodawania W kodzie komputerowym często reprezentuje tę samą koncepcję w wielu językach i trybach komunikacji (np. Tekst, obrazy).

To Październik 2023 Studium antropologiczne Pokaż, jak ten podstawowy proces może działać na bardzo małych, jednowarstwowych modelach zabawek. Nowy rozmiar papieru firmy znacznie się poszerza, określając dziesiątki milionów aktywnych funkcji w modelu Claude 3.0 Sonnet średniej klasy. Powstała mapa obiektów – którą możesz wykonać Częściowo zbadane– Tworzy „przybliżoną mapę pojęciową [Claude’s] „Stany wewnętrzne są na półmetku obliczeń” i wykazują „głębokość, szerokość i abstrakcję, które odzwierciedlają zaawansowane możliwości Sonneta” – piszą naukowcy. Jednocześnie badacze ostrzegają, że jest to „niekompletny opis wewnętrznych reprezentacji modelu”, który prawdopodobnie jest „o znaczące liczby” mniejszy niż pełne odwzorowanie Claude’a 3.

Nawet na poziomie powierzchownym przeglądanie tej mapy funkcji pomaga pokazać, jak Claude kojarzy pewne słowa kluczowe, wyrażenia i pojęcia z czymś zbliżonym do wiedzy. A Funkcja o nazwie „Stolice” Na przykład są one silnie aktywowane, gdy używa się wyrażenia „stolica”, ale także konkretnych nazw miast, takich jak Ryga, Berlin, Azerbejdżan, Islamabad i Montpelier w stanie Vermont, żeby wymienić tylko kilka.

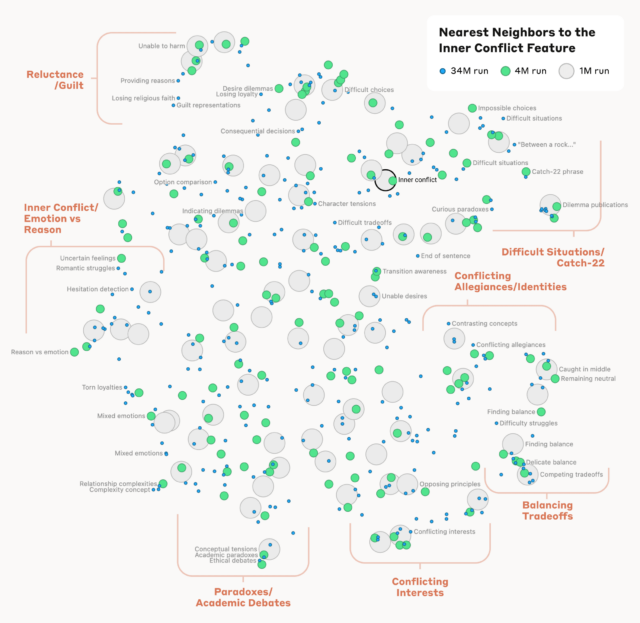

W badaniu obliczono także matematyczną miarę „odległości” między różnymi cechami na podstawie ich podobieństwa neuronowego. Powstałe w wyniku tego procesu „odrębne sąsiedztwa” „są często zorganizowane w geometrycznie powiązane grupy, które łączy wspólny związek semantyczny” – napisali badacze, wykazując, że „wewnętrzna organizacja pojęć w modelu AI odpowiada, przynajmniej w pewnym stopniu, do naszych ludzkich koncepcji.” Pojęcia podobieństwa.” Na przykład film o moście Golden Gate jest stosunkowo „bliski” obiektom opisującym „wyspę Alcatraz, Ghirardelli Square, Golden State Warriors, gubernatora Kalifornii Gavina Newsoma, trzęsienie ziemi w 1906 r. i plan filmowy Alfreda Hitchcocka w San Francisco”. zawrót głowy„.

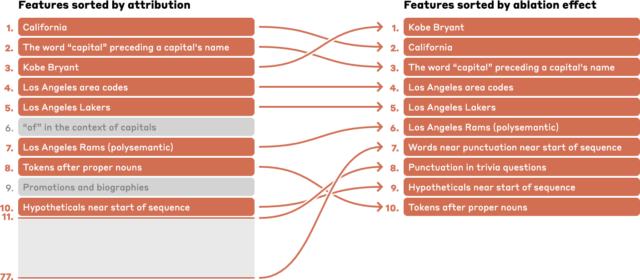

Identyfikacja konkretnych cech LLM może również pomóc badaczom w mapowaniu łańcucha wniosków, którego model używa do odpowiadania na złożone pytania. Na przykład monit dotyczący „Stolicy stanu, w którym Kobe Bryant grał w koszykówkę” pokazuje aktywność w szeregu obiektów związanych z „Kobe Bryantem”, „Los Angeles Lakers”, „Kalifornią”, „Stolicami” i „Sacramento”. ”, żeby wymienić tylko kilka, które, jak obliczono, mają największy wpływ na wyniki.

. „Telewizyjny pionier. Fan alkoholu. Namiętny komunikator. Oddany badacz kawy. Boczek ninja”.

/cdn.vox-cdn.com/uploads/chorus_asset/file/25546355/intel_13900k_tomwarren__2_.jpg)

More Stories

Nie ma rozwiązania problemu awarii procesorów Intel 13. i 14. generacji – czyli trwałego uszkodzenia

Oczekuje się, że wewnętrzna zmiana w modelach iPhone’a 16 zmniejszy wzrost temperatury

Cybertruck wkracza do Fortnite i Rocket League, bo grozi nam kara