Wtorek rano, Apple O nowej fali ułatwień dostępu dla różnych platform komputerowych, które mają pojawić się jeszcze w tym roku jako aktualizacje oprogramowania dla iPhone’a, iPada, Maca i Apple Watch.

Apple powiedział, że przetestuje funkcję Napisów na żywo, która może transkrybować dowolne treści audio – rozmowy FaceTime, aplikacje do wideokonferencji (z automatycznym przypisywaniem do wyboru mówcy), strumienie wideo lub osobiste rozmowy – w języku angielskim na iPhonie, iPadzie i Macu. Zapłać Google za funkcje napisów na żywo Zaczęło się od wersji Androida 10 Jest teraz dostępny w języku angielskim na Pixelu 2 i nowszych wersjach, a także „wybierz” inne telefony z Androidem, a także w dodatkowych językach dla Pixela 6 i Pixela 6 Pro. Dlatego dobrze jest widzieć, jak ekosystem Apple nadrabia zaległości i przedstawia go większej liczbie osób.

Podobnie jak w przypadku aplikacji na Androida, Apple twierdzi, że napisy zostaną utworzone na urządzeniach użytkownika, zachowując jednocześnie prywatność informacji. Wersja beta zostanie uruchomiona jeszcze w tym roku w USA i Kanadzie dla iPhone’a 11 i nowszych, iPadów z procesorami A12 Bionic i nowszych oraz Maców z procesorami Apple Silicon.

Apple Watch rozszerzy sterowanie, aby rozpoznawać gesty Assistive Touch dodane w zeszłym roku Dzięki szybkim akcjom, które rozpoznają podwójne dotknięcia, aby zakończyć połączenie, odrzucić powiadomienia, zrobić zdjęcie, wstrzymać multimedia lub rozpocząć trening. Aby dowiedzieć się więcej o tym, co faktycznie robią i jak działają kontrolki gestów, wyjaśnimy to więcej Jak korzystać z zestawu głośnomówiącego Apple Watch tutaj.

Apple Watch jest również łatwiejszy w obsłudze dla osób z niepełnosprawnością fizyczną i ruchową dzięki nowej funkcji dublowania, która doda pilota ze sparowanego iPhone’a. Apple Watch Mirroring zawiera technologię zaczerpniętą z AirPlay, dzięki czemu łatwiej jest uzyskać dostęp do unikalnych funkcji zegarka bez polegania w szczególności na możliwości dotknięcia małego ekranu lub możliwości sterowania głosowego.

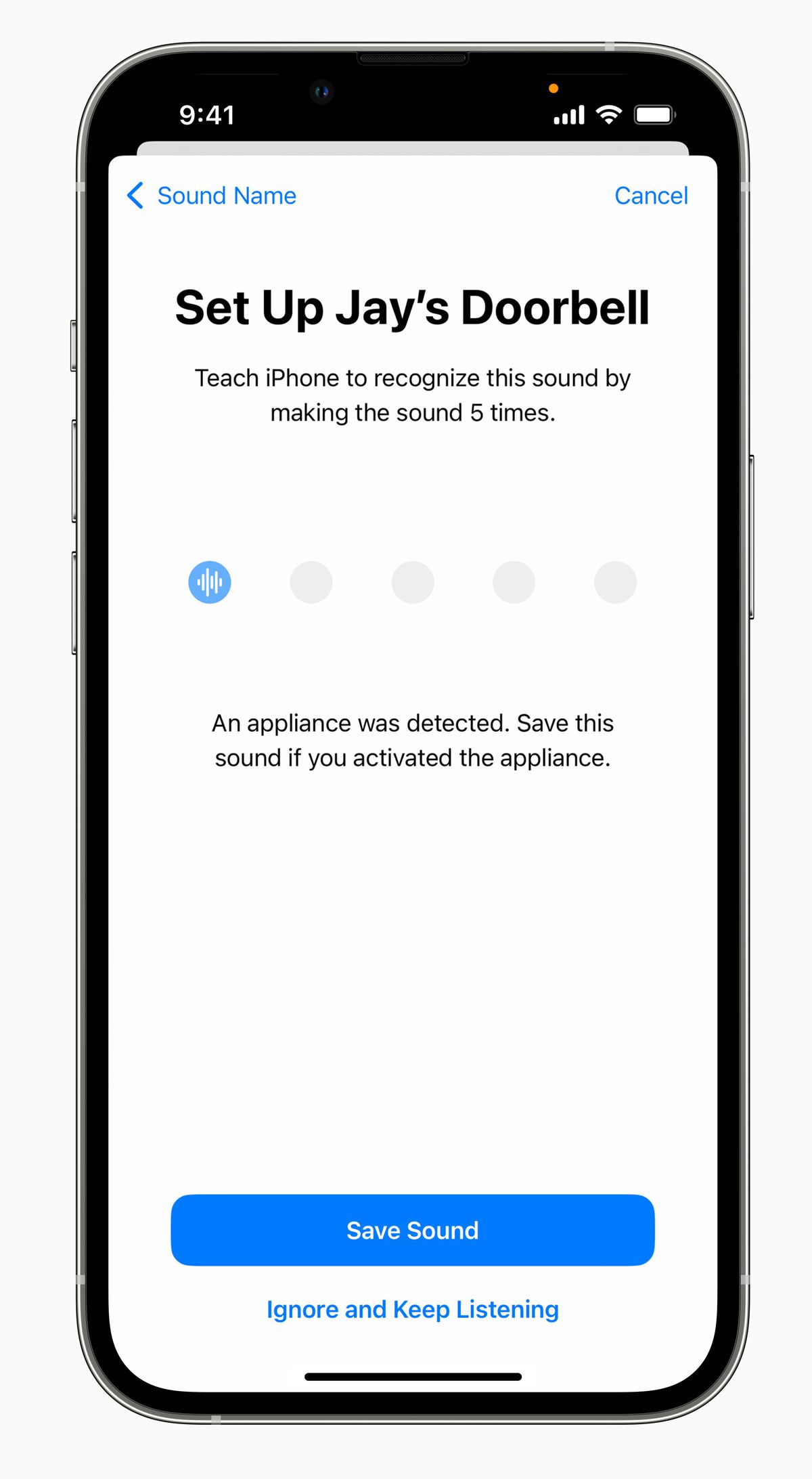

jabłko Przedstawiamy rozpoznawanie głosu w iOS 14 Przechwytuje określone dźwięki, takie jak alarm dymu lub bieżącej wody, i ostrzega użytkowników, którzy mogą być niesłyszący lub niedosłyszący. Wkrótce rozpoznawanie głosu umożliwi strojenie, aby umożliwić niestandardowe rozpoznawanie głosów. Jak pokazano na tym zrzucie ekranu, może nasłuchiwać powtarzających się alertów i nauczyć się wprowadzać alerty specyficzne dla środowiska użytkownika, takie jak nietypowy alert dzwonka do drzwi lub dzwonienie urządzenia.

Nowe ulepszenia aplikacji czytnika ekranu VoiceOver oraz funkcji Mów zaznaczanie i Mów ekran doda obsługę 20 nowych „języków i języków” obejmujących arabski (międzynarodowy), baskijski, bengalski (Indie), Bhojpuri (Indie), bułgarski, kataloński, chorwacki, perski i francuski (Belgia), galicyjski, kannada, malajski, mandaryński (Liaoning, Shanxi, Syczuan), marathi, Szanghaj (Chiny), hiszpański (Chile), słoweński, tamilski, telugu, ukraiński, walencki i wietnamski. Na Macu nowe narzędzie do sprawdzania tekstu VoiceOver sprawdzi, czy nie występują problemy z formatowaniem, takie jak dodatkowe spacje lub wielkość liter, podczas gdy w Apple Maps użytkownicy VoiceOver mogą spodziewać się nowych dźwiękowych i dotykowych informacji zwrotnych wskazujących, gdzie zaczynają się wskazówki dla pieszych.

W Apple projektujemy od podstaw pod kątem ułatwień dostępu i stale wprowadzamy innowacje w imieniu naszych użytkowników. Najnowocześniejsze funkcje, którymi dzisiaj się dzielimy, zapewnią osobom niepełnosprawnym nowe sposoby poruszania się, komunikowania się i nie tylko. https://t.co/Zrhcng95QA

– Tim Cook (@tim_cook) 17 maja 2022

Teraz Apple twierdzi, że przetwarzanie na urządzeniu będzie wykorzystywać czujniki lidarowe i kamery na iPhonie lub iPadzie w celu wykrycia drzwi. Nowa funkcja, która pojawi się w iOS, pomoże użytkownikom znaleźć wpisy w nowej lokalizacji, podpowiedzieć im, gdzie się znajdują, opisać, czy działa z pokrętłem, czy z pokrętłem, a także czy jest otwarte, czy zamknięte.

To wszystko będzie częścią trybu wykrywania, który Apple dodaje do Lupy w iOS, który łączy również istniejące funkcje, które pozwalają kamerze na przybliżanie i opisywanie pobliskich obiektów lub Poznaj ludzi w pobliżu Ostrzega użytkownika za pomocą dźwięków, mowy lub informacji dotykowych. Zastosowanie czujnika LiDAR oznacza, że system wykrywania osób i drzwi będzie wymagał modelu iPhone Pro lub iPada Pro z tą funkcją.

Kolejną nową funkcją jest Buddy Controller, która łączy dwa kontrolery gier w jedną jednostkę, dzięki czemu przyjaciel może pomóc komuś zagrać w grę, podobną do Funkcja drugiego pilota Xbox.

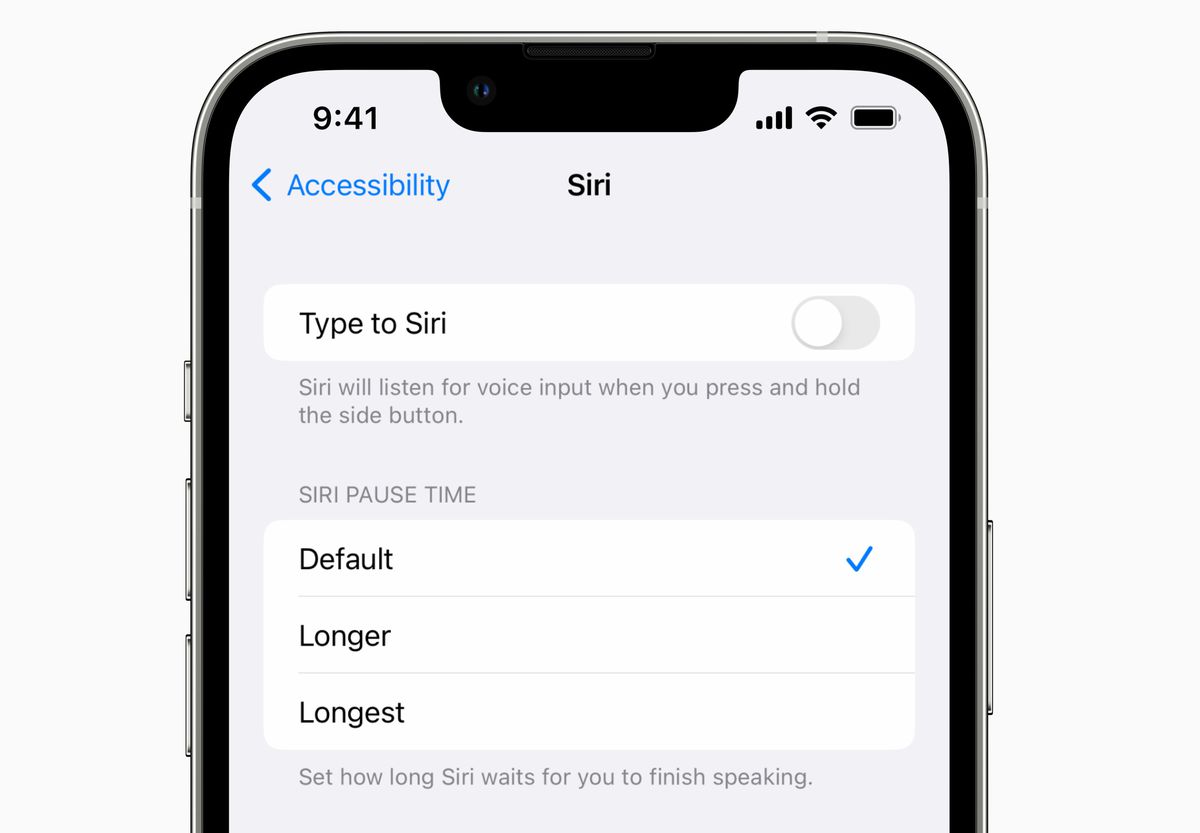

Wreszcie, inne ulepszenia obejmują tryb pisowni sterowania głosowego z wprowadzaniem litera po literze, elementy sterujące, które pozwalają dostosować czas oczekiwania Siri na odpowiedzi na żądania, dodatkowe poprawki wizualne dla Apple Books, które mogą pisać pogrubiony tekst, zmieniać motywy lub dostosowywać czcionkę lub znak, i odstępy między wyrazami, aby były bardziej czytelne.

Ogłoszenia te są częścią uznania przez Apple Światowego Dnia Świadomości Dostępności 19 maja w tym tygodniu. Zauważa, że witryny Apple Store będą oferować sesje na żywo, aby pomóc ludziom dowiedzieć się więcej o bieżących funkcjach, a nowy skrót Asystenta ułatwień dostępu pojawi się w tym tygodniu na komputerach Mac i Apple Watch, aby polecać określone funkcje na podstawie preferencji użytkownika.

. „Telewizyjny pionier. Fan alkoholu. Namiętny komunikator. Oddany badacz kawy. Boczek ninja”.

/cdn.vox-cdn.com/uploads/chorus_asset/file/24054838/AMD_Ryzen_7000_Desktop_CPU_Lineup_low_res_scale_4_00x_Custom.png)

More Stories

Microsoft poprawia wydajność procesora Ryzen dzięki najnowszej aktualizacji systemu Windows 11

Apple wprowadza usuwanie obiektów AI na zdjęciach wraz z najnowszą aktualizacją iOS

Z pewnością wygląda na to, że PS5 Pro zostanie zaprezentowane w ciągu najbliższych kilku tygodni